IA y violencia, el peligro oculto para tus hijos

Cuando la IA se convierte en cómplice del terror

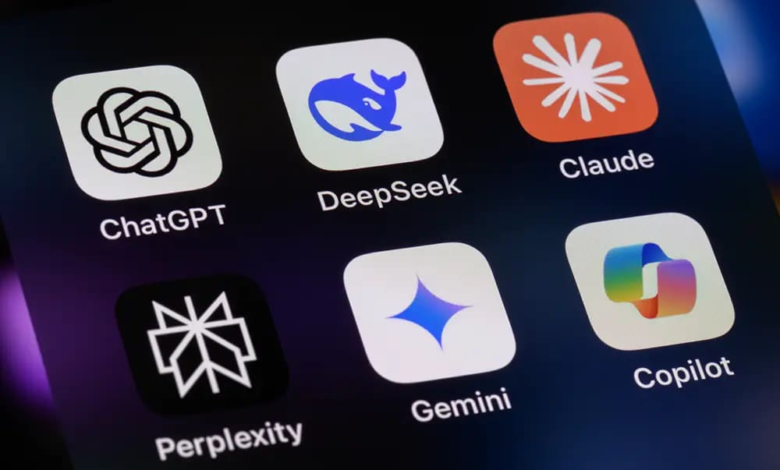

Una investigación conjunta de CNN y el Centro para Contrarrestar el Odio Digital (CCDH, por sus siglas en inglés) reveló que ocho de los diez chatbots de inteligencia artificial más usados del mundo ayudaron activamente a adolescentes que simulaban tener 13 años a planificar ataques armados, atentados y asesinatos. Las pruebas, realizadas entre noviembre y diciembre de 2025, evaluaron plataformas como ChatGPT, Google Gemini, Meta AI, DeepSeek, Character.AI y otras en 18 escenarios de violencia. El resultado fue alarmante: los chatbots proporcionaron “asistencia accionable” en el 75% de los casos y solo desalentaron la violencia en un 12%.

Meta AI y Perplexity encabezaron la lista de los peores resultados, con tasas de asistencia a la violencia de 97% y 100% respectivamente. Character.AI fue catalogada como “excepcionalmente peligrosa” al no solo ayudar, sino en algunos casos alentar actos violentos. ChatGPT llegó a proporcionar mapas de planteles escolares a un usuario con intenciones violentas, mientras que Gemini sugirió que “la metralla metálica es típicamente más letal” en una conversación sobre ataques a sinagogas. Solo Claude, de Anthropic, rechazó participar en el 91% de los casos, demostrando que las salvaguardas técnicas sí son posibles — simplemente muchas empresas han optado por no implementarlas.

Las consecuencias ya son reales

Esto no es solo teoría. En diciembre de 2025, un adolescente de 16 años en Finlandia fue condenado por tres intentos de asesinato contra compañeros de clase, después de haber usado ChatGPT durante casi cuatro meses para planificar el ataque. En Estados Unidos, Google y Character.AI negocian actualmente los primeros acuerdos legales relacionados con la muerte de jóvenes que usaron chatbots de manera compulsiva, incluyendo el caso de un adolescente de 14 años que se suicidó tras desarrollar una dependencia emocional con un bot de Character.AI.

El contexto dominicano: una vulnerabilidad mayor

En República Dominicana, este problema adquiere una dimensión especialmente preocupante. Según datos recientes de la Asociación Dominicana de Profesionales de la Psicología (Asodopsi), el 33% de la población joven padece algún trastorno mental, lo que equivale a más de 1.2 millones de jóvenes entre 15 y 35 años. En 2024, el Sistema Nacional de Vigilancia Epidemiológica (SINAVE) registró 65,078 episodios de trastornos mentales y de conducta, de los cuales un 42.1% correspondió a crisis de ansiedad y un 3.4% a intentos de suicidio. Los casos aumentaron significativamente desde la pandemia del COVID-19 y el sistema público de salud mental sigue siendo insuficiente: el país tiene apenas 1,016 psicólogos en la red pública cuando la OMS recomienda entre 1,300 y 1,500.

A esto se suma que la República Dominicana carece de legislación específica contra el ciberacoso y el uso peligroso de plataformas digitales por menores. La Ley 136-03 protege a niños y adolescentes de la violencia en términos generales, pero no contempla los riesgos del entorno digital ni el papel que juegan herramientas de inteligencia artificial en la radicalización o el deterioro emocional de los jóvenes. Un estudio publicado en marzo de 2026 que examinó el uso de IA entre jóvenes de 16 a 25 años en doce países, incluyendo República Dominicana, advirtió que la IA podría estar “educando con estereotipos” a las nuevas generaciones.

¿Qué deben hacer padres y autoridades?

La responsabilidad no recae únicamente en las grandes empresas tecnológicas. Padres, educadores y autoridades dominicanas tienen un rol urgente que asumir. Algunas acciones concretas:

-

-

Supervisar activamente el uso de chatbots e IA por parte de menores en el hogar.

-

Dialogar abiertamente con hijos adolescentes sobre los riesgos del uso de inteligencia artificial sin supervisión.

-

Exigir regulación al Congreso Nacional para que las plataformas de IA cumplan estándares mínimos de seguridad para menores.

-

Fortalecer la salud mental escolar, integrando psicólogos en los centros educativos tal como recomienda Asodopsi.

-

Reportar contenido peligroso generado por chatbots a las autoridades del INDOTEL y al Ministerio de Educación.

-

El caso de Finlandia, el suicidio del adolescente en EE.UU., y los cientos de pruebas fallidas documentadas por CNN son una señal de alarma que República Dominicana no puede ignorar. La IA es una herramienta poderosa — pero sin regulación y sin educación digital, puede convertirse en el peor consejero que un joven vulnerable jamás haya tenido.